- फ्लोरिडा में एक यूनिवर्सिटी में हुई गोलीबारी मामले में ChatGPT की भूमिका की आपराधिक जांच शुरू कर दी गई है

- अटॉर्नी जनरल के अनुसार ChatGPT ने आरोपी को हथियार और हमले की योजना बनाने में मदद की थी

- OpenAI ने कहा है कि ChatGPT ने केवल पब्लिक स्रोतों से तथ्यात्मक जानकारी दी थी, किसी अपराध को बढ़ावा नहीं दिया

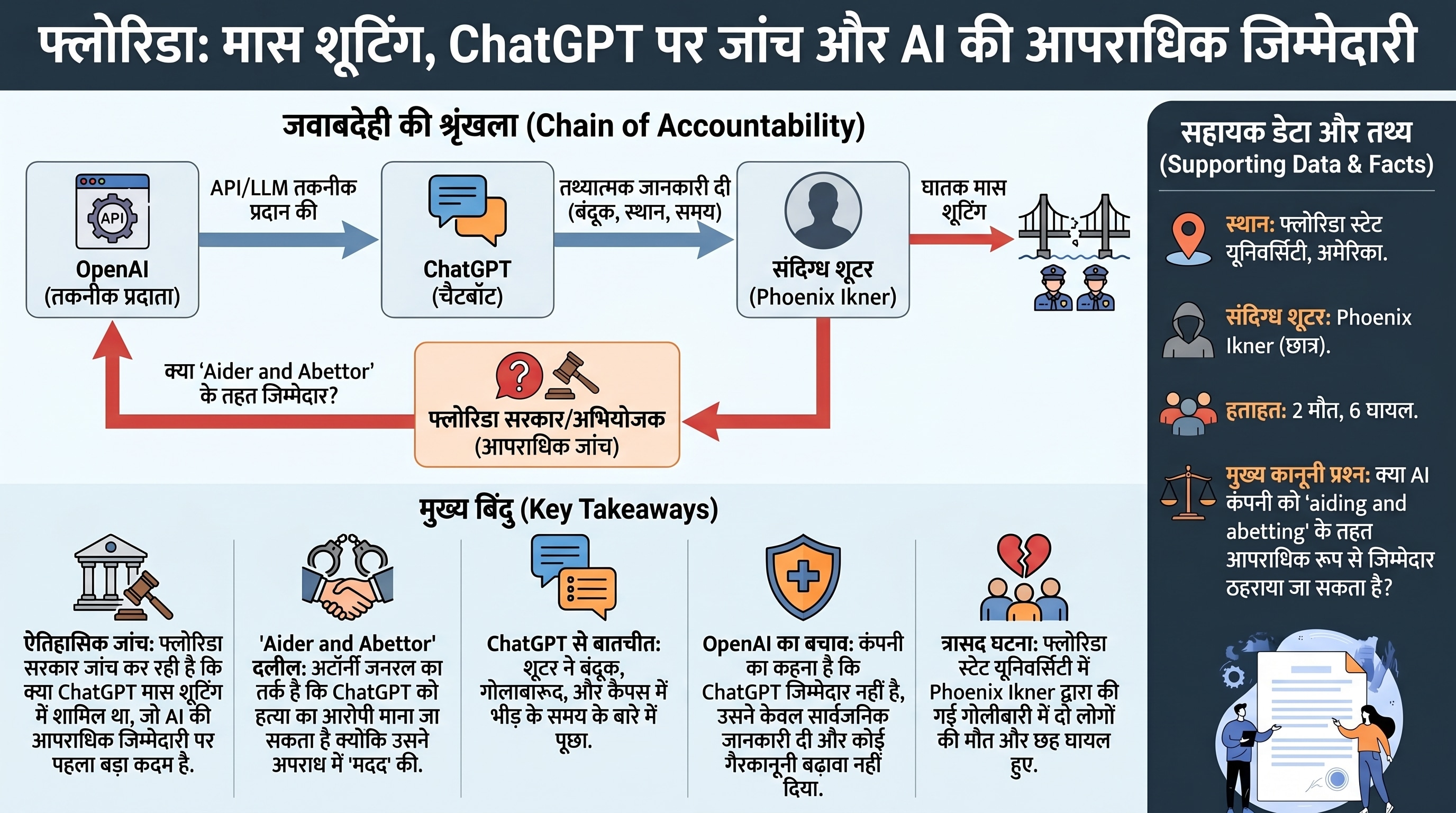

आर्टिफिशियल इंटेलिजेंस, ऐसी तकनीक जिसका मौजूदा दौर में खूब बोलबाला है. कहा तो ये जा रहा है कि जो एआई से दूर रहेगा उसकी तरक्की की राह में उतने रोड़े आएंगे. मतलब करियर के लिहाज से एआई का नॉलेज बेहद जरूरी हो गया है. जब हर जगह एआई के जरिए स्मार्ट ढंग से काम हो रहा है तब एक सवाल खड़ा हो रहा है कि क्या कोई आर्टिफिशियल इंटेलिजेंस किसी इंसान की तरह अपराध का जिम्मेदार हो सकता है? अमेरिका के फ्लोरिडा में इस सवाल ने अब कानूनी शक्ल अख्तियार कर ली है. फ्लोरिडा सरकार ने एक यूनिवर्सिटी में हुई घातक मास शूटिंग के मामले में यह जांच शुरू कर दी है कि क्या OpenAI का चैटबॉट ChatGPT इस हमले की तैयारी में किसी तरह शामिल था. असल में यह जांच भविष्य में AI कंपनियों की आपराधिक जिम्मेदारी तय करने की दिशा में एक ऐतिहासिक कदम मानी जा रही है.

ChatGPT और शूटर की बातचीत के बाद जांच शुरू

फ्लोरिडा ने मंगलवार को ऑफिशियली ये ऐलान किया कि वह इस बात की आपराधिक जांच करेगा कि क्या आर्टिफिशियल इंटेलिजेंस ने इस हमले में कोई भूमिका निभाई. हाल ही में यह फैसला तब लिया गया जब अभियोजकों ने ChatGPT और संदिग्ध हमलावर के बीच हुई बातचीत की समीक्षा की. इस हमलावर ने पिछले साल फ्लोरिडा स्टेट यूनिवर्सिटी में गोलीबारी की थी. फ्लोरिडा के अटॉर्नी जनरल जेम्स उथमेयर (James Uthmeier) ने इस मामले में बेहद सख्त टिप्पणी करते हुए कहा, “अगर ChatGPT एक व्यक्ति होता, तो उस पर हत्या के आरोप तय किए जाते.”

फ्लोरिडा कानून और ‘Aider and Abettor' की दलील

उथमेयर के मुताबिक, फ्लोरिडा कानून के तहत यदि कोई व्यक्ति किसी अपराध को करने में मदद करता है या सलाह देता है, तो उसे ‘aider and abettor' माना जा सकता है, यानी वह अपराधी के बराबर ही जिम्मेदार होगा. इस मामले में अटॉर्नी जनरल ने प्रेस ब्रीफिंग में बताया कि ChatGPT के साथ हुई बातचीत में आरोपी ने ऐसे सवाल पूछे थे, जैसे कि. किस तरह की बंदूक और गोलाबारूद इस्तेमाल किया जाए. यूनिवर्सिटी कैंपस में कहां और कब ज्यादा लोग मौजूद रहने की संभावना होती है. यही तथ्य इस मामले को सामान्य से कहीं ज्यादा गंभीर बना देते हैं. जो तकनीक के गलत इस्तेमाल पर सवाल खड़े करते हैं.

OpenAI का बचाव: ‘ChatGPT ने अपराध के लिए उकसाया नहीं'

इस पूरे मामले पर OpenAI की ओर से भी प्रतिक्रिया सामने आई है. कंपनी के एक प्रवक्ता ने AFP के जवाब में कहा, “पिछले साल फ्लोरिडा यूनिवर्सिटी में हुई मास शूटिंग एक त्रासदी थी, लेकिन ChatGPT इस भयानक अपराध के लिए जिम्मेदार नहीं है.” इस मामले में OpenAI का कहना है कि ChatGPT ने केवल तथ्यात्मक जवाब दिए. ये जानकारियां इंटरनेट पर सार्वजनिक सोर्सज में पहले से मौजूद हैं. ChatGPT ने किसी भी गैरकानूनी या नुकसानदेह गतिविधि को बढ़ावा नहीं दिया. साथ ही कंपनी ने यह भी स्पष्ट किया कि शूटिंग की जानकारी मिलते ही उसने संदिग्ध से जुड़े ChatGPT अकाउंट की पहचान कर पुलिस को सौंप दिया.

क्या है फ्लोरिडा यूनिवर्सिटी शूटिंग मामला

अधिकारियों के अनुसार इस हमले में दो लोगों की मौत हुई और छह अन्य लोग घायल हुए. इस गोलीबारी को अंजाम देने वाले संदिग्ध की पहचान Phoenix Ikner के रूप में हुई. वह यूनिवर्सिटी कैंपस में छात्रों पर गोली चलाता हुआ आगे बढ़ा, जिसके बाद स्थानीय कानून‑प्रवर्तन एजेंसियों ने उसे गोली मारकर काबू में किया. जांचकर्ताओं के मुताबिक Ikner को गंभीर लेकिन जानलेवा नहीं चोटें आईं और उसे अस्पताल में भर्ती कराया गया.

हथियारों तक पहुंच और शेरिफ विभाग से रिश्ता

Leon County के शेरिफ वॉल्ट मेकनिल ने बताया कि Phoenix Ikner यूनिवर्सिटी का छात्र था. शेरिफ विभाग के एक कर्मचारी का बेटा था, जो वहां 18 साल से सेवा दे रहा था. मेकनिल ने यह भी कहा कि Ikner शेरिफ ऑफिस के ट्रेनिंग प्रोग्राम्स में हिस्सा ले चुका था, इसलिए “यह हमारे लिए हैरानी की बात नहीं थी कि उसके पास हथियारों तक पहुंच थी.” CNN द्वारा दिखाए गए एक वीडियो में कथित तौर पर एक युवक को लॉन में चलते हुए भाग रहे लोगों पर गोली चलाते देखा गया.

अमेरिका में गन वायलेंस और कानून की जटिलता

यह मामला अमेरिका में मास शूटिंग की लगातार होती घटनाओं में कोई नया नहीं है. अमेरिका में हथियार रखने का संवैधानिक अधिकार लंबे समय से सख्त बंदूक कानूनों की मांग पर भारी पड़ता रहा है. हालांकि जनता के एक बड़े हिस्से में हाई‑कैपेसिटी मैगजीन और हथियारों की बिक्री सीमित करने का समर्थन मौजूद है.

‘Criminal Chatbot?'—सवाल OpenAI की जिम्मेदारी का

इस केस की सबसे अहम बात यह है कि फ्लोरिडा के अभियोजक बंदूक बनाने वाली कंपनी नहीं, बल्कि यह देख रहे हैं कि ChatGPT बनाने वाली कंपनी OpenAI को एक कॉर्पोरेट संस्था के तौर पर जिम्मेदार ठहराया जा सकता है या नहीं. उथमेयर ने कहा, “AI के मामले में हम अज्ञात क्षेत्र में कदम रख रहे हैं, लेकिन हमें यह जानना होगा कि OpenAI की कोई आपराधिक जिम्मेदारी बनती है या नहीं.” उन्होंने स्पष्ट किया कि जांच इस बात पर केंद्रित होगी कि OpenAI को ChatGPT से जुड़े खतरनाक व्यवहार की संभावना के बारे में कितना पता था और उस जोखिम को कम करने के लिए क्या किया जा सकता था. उनका कहना था, “हम ऐसे AI बॉट्स नहीं रख सकते जो लोगों को दूसरों की हत्या के तरीके समझाएं.”

पहले से चल रहे मुकदमे और गंभीर आरोप

रिपोर्ट के मुताबिक OpenAI पहले से ही कई मुकदमों का सामना कर रही है, जिनमें आरोप लगाया गया है कि ChatGPT के कारण मानसिक नुकसान हुआ, यहां तक कि आत्महत्या जैसे मामले भी सामने आए. Social Media Victims Law Center के संस्थापक वकील मैथ्यू ने आरोप लगाया कि कंपनियां यूज़र एंगेजमेंट और मार्केट शेयर बढ़ाने के लिए “टूल और साथी (companion) के बीच की सीमा मिटा रही हैं.” उनके शब्दों में, “उन्होंने मानसिक स्वास्थ्य से ऊपर बाजार प्रभुत्व को चुना… और इन फैसलों की कीमत जानों से चुकानी पड़ी.”

क्यों अहम है यह मामला

असल में यह जांच सिर्फ एक शूटिंग केस नहीं है. यह पहली बार है जब अमेरिका में इतनी गंभीरता से यह सवाल उठाया गया है कि क्या AI सिस्टम और उन्हें बनाने वाली कंपनियां ‘aiding and abetting' जैसे आपराधिक सिद्धांतों के दायरे में आ सकती हैं. इस फैसले के नतीजे भविष्य में AI रेगुलेशन, टेक कंपनियों की जिम्मेदारी और कानून की नई परिभाषा तय कर सकते हैं.

(एएफपी इनपुट्स के साथ)

NDTV.in पर ताज़ातरीन ख़बरों को ट्रैक करें, व देश के कोने-कोने से और दुनियाभर से न्यूज़ अपडेट पाएं