- केंद्रीय मंत्री अश्विनी वैष्णव ने डीपफेक के खतरों से सावधान करते हुए भारत की दोहरी रणनीति के बारे में बताया

- NDTV World Summit में उन्होंने कहा कि सरकार तकनीकी समाधान और कानूनी नियमों पर काम कर रही है

- भारत अन्य देशों की तुलना में तकनीकी और कानूनी उपायों को एक साथ लागू करने में तेजी से आगे बढ़ रहा है

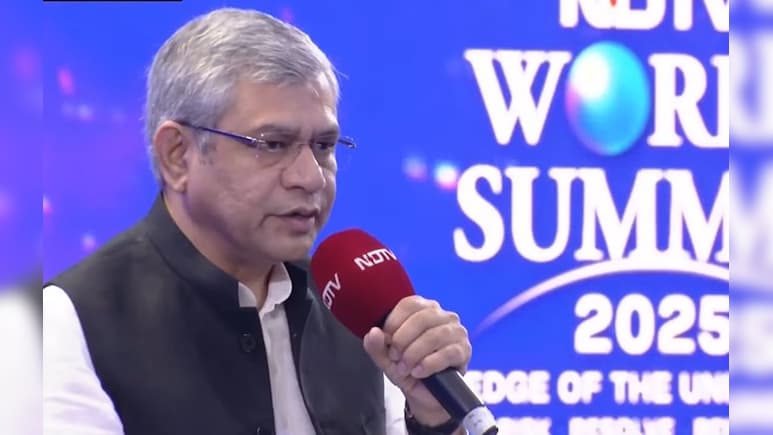

एनडीटीवी वर्ल्ड समिट (NDTV World Summit) के मंच से केंद्रीय मंत्री अश्विनी वैष्णव ने लोगों को डीपफेक (Deepfake) के बढ़ते खतरों के प्रति आगाह किया. उन्होंने ये भी बताया कि दुनिया के बाकी देशों की तुलना में भारत, किस तरह आगे बढ़कर समाधान तलाश रहा है. केंद्रीय संचार, इलेक्ट्रॉनिक्स और सूचना प्रौद्योगिकी मंत्री ने बताया कि सरकार इस गंभीर चुनौती से निपटने के लिए दोहरी रणनीति पर काम कर रही है. पहला- तकनीकी समाधान और दूसरा- कानूनी नियमन.

मंत्री वैष्णव ने कहा कि जहां AI (आर्टिफिशियल इंटेलिजेंस) के कई रचनात्मक और मजेदार पहलू हैं, वहीं डीपफेक के माध्यम से किसी व्यक्ति की आवाज और चेहरे को गलत तरीके से पेश करना एकदम अस्वीकार्य है. कहा- आपका चेहरा, आपकी आवाज इस्तेमाल कर ऐसा संदेश दिया जाता है, जिससे दूर-दूर तक आपका नाता ही नहीं. उन्होंने जोर देते हुए कहा, 'यह आपका अधिकार है कि आपकी आवाज और चेहरा गलत तरीके से इस्तेमाल नहीं होना चाहिए.'

दोतरफा समाधान पर सरकार का फोकस

वैष्णव ने वैश्विक संदर्भ में भारत की पहल को मजबूत बताया और कहा कि जहां यूरोपीय देश केवल नियमों (लीगल सॉल्यूशंस) पर ध्यान केंद्रित कर रहे हैं, वहीं भारत तकनीकी और कानूनी दोनों समाधानों को एक साथ लागू करने की दिशा में तेजी से आगे बढ़ रहा है. उन्होंने आश्वस्त किया कि डीपफेक को नियंत्रित करने के लिए जल्द ही व्यापक नियम लाए जाएंगे. केंद्रीय मंत्री ने बताया कि डीपफेक से लड़ने के लिए सरकार दो मोर्चे पर काम कर रही है.

- तकनीकी समाधान: इस दिशा में आईआईटी जोधपुर ने डीपफेक कंटेंट को डिटेक्ट करने (पहचानने) की एक प्रभावी तकनीक विकसित की है. यह तकनीकी समाधान डीपफेक वीडियो और ऑडियो को वास्तविक कंटेंट से अलग करने में मदद करेगा.

- कानूनी समाधान (रेगुलेशन): सरकार जल्द ही डीपफेक के लिए कड़े नियम (रेगुलेशन) तैयार करने में लगी हुई है. मंत्री ने कहा कि ये नियम यह सुनिश्चित करेंगे कि व्यक्तिगत निजता और पहचान का उल्लंघन न हो. उन्होंने बताया कि इस कार्य में एआई सेफ्टी इंस्टीट्यूट जैसी संस्थाएं भी शामिल हैं.

क्या होता है डीपफेक?

डीपफेक एक प्रकार का सिंथेटिक मीडिया है, जिसे आर्टिफिशियल इंटेलिजेंस (AI) और मशीन लर्निंग (Machine Learning) जैसी तकनीकों का उपयोग करके बनाया जाता है. इसमें किसी मौजूदा वीडियो, ऑडियो या छवि को इस तरह से बदला या हेरफेर किया जाता है कि वह पूरी तरह से असली लगे.

उदाहरण के लिए, डीपफेक आपके चेहरे को किसी अन्य व्यक्ति के शरीर पर लगा सकता है, या आपकी आवाज की हूबहू नकल करके उससे वो बातें कहवा सकता है जो आपने कभी नहीं कही. पिछले कुछ वर्षों में रश्मिका मंदाना, अमिताभ बच्चन और कई अन्य शख्सियत इसका शिकार हो चुके हैं. प्रधानमंत्री नरेंद्र मोदी भी डीपफेक के प्रति लोगों को सावधान कर चुके हैं.

डीपफेक के खतरे क्या हैं?

डीपफेक के न केवल व्यक्तिगत और वित्तीय नुकसान हैं, बल्कि इससे राजनीतिक अस्थिरता, सामाजिक कलंक, मानहानि जैसी स्थितियां भी पैदा हो सकती हैं. डीपफेक का उपयोग करके फर्जी वीडियो बनाकर ब्लैकमेलिंग, धोखाधड़ी और पहचान की चोरी की जा सकती है. किसी भी आम व्यक्ति या हस्ती की छवि खराब करने के लिए डीपफेक कंटेंट का दुरुपयोग किया जा सकता है, जिससे उनकी प्रतिष्ठा को भारी नुकसान पहुंच सकता है.

चुनाव से पहले या किसी संकट के दौरान इसका इस्तेमाल प्रमुख राजनेताओं या हस्तियों के झूठे बयान प्रसारित करने के लिए किया जा सकता है, जिससे जनता में भ्रम और अविश्वास पैदा होता है. यदि लोग वास्तविक और नकली कंटेंट के बीच अंतर नहीं कर पाते हैं, तो मीडिया और सूचना पर उनका विश्वास कम होता है, जो अंततः लोकतांत्रिक प्रक्रियाओं को कमजोर करता है.

NDTV.in पर ताज़ातरीन ख़बरों को ट्रैक करें, व देश के कोने-कोने से और दुनियाभर से न्यूज़ अपडेट पाएं